Wertetabelle:

x y Ausgabe

0 0 0

0 1 1

1 0 1

0 0 0

|

|

| |

|

Zwei Spiralen Problem. Die Aufgabe ist, zwischen zwei Trainingsmengen die auf zwei unterschiedlichen Spiralen in der x-y Ebene liegen (im Bild blau und rot), zu unterscheiden. Beide Spiralen winden sich drei mal um den Nullpunkt und um sich selber. Diese Problem wird oft als Benchmark-Test für neue Verfahren verwendet. |

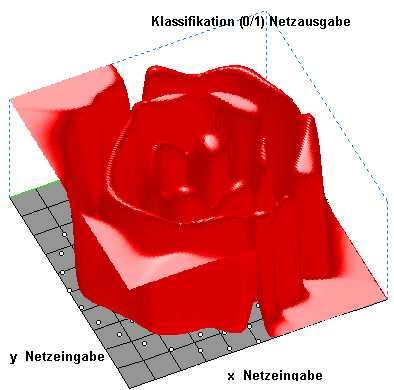

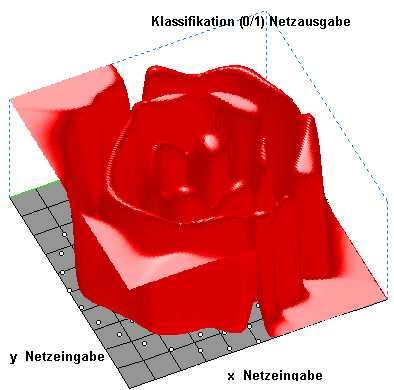

Zwei Spiralen Problem Fortsetzung. Für einen MLP Netz mit back-propagation-Algorithmus, ist es sehr schwer die Klassifizierung zu erlernen. Es sind sehr viele Hidden Neuronen und Lernschritte nötig. Das erlernte Netz ist in der obigen Darstellung visualisiert. Die beiden Eingabewerte werden auf der x- und y-Achsen abgetragen, auf der z-Achse ist die Netzwerkausgabe (Klassifikation 0 /1)aufgetragen. Netzwerk: MLP 2-20-10-1 (Zwei Eingabeneuronen, zwei hidden-Layer mit jeweils 20 und 10 Neuronen in der Schicht und einem Ausgabeneuron). |

Gleiche Fläche wie Bild nebenan nur mit mehr Facetten und ohne Facettenrand. |

|

|

|

||

|

XOR Problem mit zwei Eingängen. Xor ist eine Binäre Funktion (exklusives oder) die nicht linear seperabel ist und deshalb nicht von einem singel-layer-perceptron erlernt werden kann. Wertetabelle: x y Ausgabe 0 0 0 0 1 1 1 0 1 0 0 0 |

Die 4 Zeilen der Wertetabelle dienen dem MLP mit zwei Eingaben, zwei Neuronen in der hidden-Schicht und einem Ausgabeneuron als Trainingsdatensätze. Beide Modelle in den obigen Darstellungen können die 4 Datensätze richtig klassifizieren sind also korrekte Lösungen, interpolieren aber zwischen den Trainingsdatensätze anders. Beide Modelle wurden jeweils mit andern Zufallsgewichte initialisiert. | ||